Synthetische media: Deepfakes worden de nieuwe Corporate Training Tool

De modellen hiernaast, bestaan niet.

Credits: Rosebud AI

Door het Coronavirus zijn we allemaal wat beperkt in ons doen en laten. Wat doe je dan wanneer je een bedrijfsvideo wil opnemen? Hebben we – met alle technologische nieuwigheden – nog acteurs nodig?

Sommige bedrijven wenden zich in plaats daarvan tot “synthetische media”.

Reclamegigant WPP zet meteen de toon, door deze zomer (07/2020) ongewone bedrijfstrainingsvideo’s te sturen naar tienduizenden werknemers over de hele wereld.

Een presentator zal in de taal van de ontvanger spreken en hem of haar bij naam noemen, en vervolgens de bedrijfsboodschap brengen. Het gezicht in de video en de gesproken woorden, zullen worden gesynthetiseerd door software. Meteen een krachtige demonstratie van wat AI kan doen.

Zijn toekomstige trainings- en reclamevideobeelden voortaan volledig computer – synthetisch – gegenereerd?

Deepfakes

De techniek valt onder de noemer deepfakes. Ik schreef daar al eerder over, en de bijhorende gevaren. Lees: Ben jij bestand tegen deepfake?

WPP gebruikt de term ‘deepfakes’ zelf niet; eerder “synthetische trainingsvideo’s”. In elk geval gaat het over een techniek, toegepast op beelden of video’s die worden gegenereerd met behulp van AI die er dan levensecht uitzien.

De trainingsvideo’s van WPP, gemaakt met technologie van de Londense startup Synthesia, zijn niet perfect. De prosodie van de presentatoren is nog niet geheel juist (dat betekent het ritme, de klemtoon en de intonatie van de stem bij het uitspreken van een zin of zinsdeel). Maar de mogelijkheid om elke video te personaliseren per ontvangende individu en diens locatie (taal), maakt het bijzonder en de ontwikkelingen gaan snel.

Kostprijs

Werken met deepfake kan goedkoop en snel zijn, en menselijk contact is niet nodig. Een troef die – tijdens Covid19 – nog belangrijker werd.

Wil je als bedrijf een corporate videoboodschap uitsturen, naar een wereldwijd personeelsbestand, dan heb je tig scripts en vertalingen nodig. En dat kost tijd en geld.

Met de technologie van Synthesia kunnen er avatars ingezet worden, die divers zijn, uw naam uitspreken, het hebben over de specifieke entiteit van het bedrijf waartoe je behoort, in uw taal… en dit alles voor een fractie van de gebruikelijke kost.

In de WPP-trainingscampagne van deze zomer zijn de talen beperkt tot Engels, Spaans en Mandarijns. Het zijn clips, 20 modules van ongeveer 5 minuten elk, voor 50.000 medewerkers.

De gevaren

Deepfakes zijn helaas ook al ingezet tegen activisten en politici, en een zorg onder wetgevers en social media beheerders, zeker wat betreft (politieke) desinformatie. Hoewel ze ook worden gebruikt voor de fun, zoals het invoegen van Nicolas Cage in films waar hij nooit in meespeelde.

Exit mens?

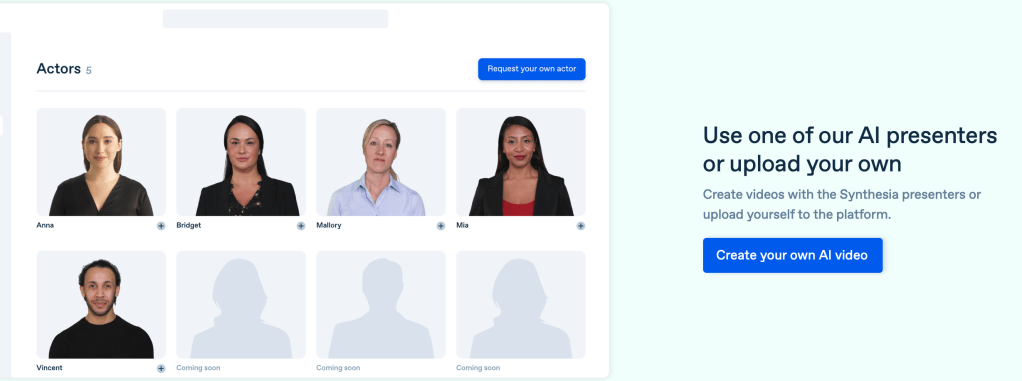

Door de technologie is de vraag naar acteurs minder relevant geworden. In het aanleveren van “synthetische gezichten”, is de startup ‘Rosebud AI’ gespecialiseerd.

Zij maken afbeeldingen zoals die gebruikt worden in e-commerce of marketing. Vorig jaar heeft het bedrijf een collectie van 25.000 modelfoto’s uitgebracht van mensen die nooit hebben bestaan, samen met tools die synthetische gezichten kunnen ruilen voor eender welke foto.

Startup Rosebud heeft AI-software ontwikkeld die beelden kan genereren van modellen met verschillende verschijningsvormen. De mensen hiernaast, bestaan niet.

Credits: Rosebud

Het gezicht in een stockfoto kan met een paar klikken veranderd worden, inclusief de schijnbare etniciteit van een persoon, een taak die anders onpraktisch zou zijn of zorgvuldig Photoshop-werk zou vereisen (en dus extra kosten).

Meer recent lanceerde het een dienst die op ‘mannequins gefotografeerde kleren’ kan overzetten op virtuele maar echt uitziende modellen.

Kleine merken kunnen daardoor, met beperkte middelen, sterkere fotoportfolio’s produceren en met meer diverse gezichten. Vroeger moest je een groot creatief team hebben en stockfoto’s kopen; voortaan gaan de algoritmes aan het werk.

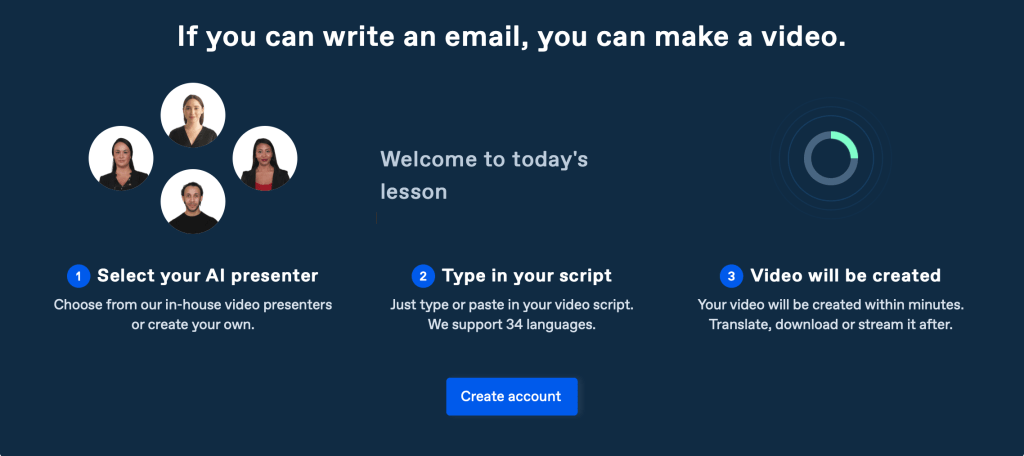

Het maken van een video met de tools van Synthesia kan seconden duren. Het is zo simpel als het selecteren van een avatar. Je voegt het script in en klikt op de knop “Genereer video”.

Avatars van menselijke oorsprong

De avatars van het bedrijf zijn wel gebaseerd op echte mensen, die royalty’s ontvangen op basis van de hoeveelheid beeldmateriaal die met hun beeld wordt gemaakt. De video van een echte persoon wordt door de algoritmes van Synthesia bijgewerkt om nieuwe videoframes te genereren. Daarin worden de bewegingen van hun gezicht afgestemd op de woorden van een gesynthetiseerde stem, die in meer dan 20 talen beschikbaar is.

Lees mijn interview over het gebruik van AI in mailcommunicatie naar klanten en prospects.

Interview met Conversica: AI gedreven assistenten zorgen voor extra business

In de praktijk

Synthesia leverde al video’s met gesynthetiseerde gesprekskoppen voor zakelijke klanten, waaronder Accenture en SAP. Vorig jaar hielp het David Beckham om een boodschap over malaria te brengen. Hij deed dat in verschillende talen, waaronder Hindi, Arabisch en Kinyarwanda, dat door miljoenen mensen in Rwanda wordt gesproken.

De talen gaan perfect in elkaar over, met de juiste lapbewegingen. De stem is echter niet identiek en je hoort het verschil in man versus vrouw.

Lees mijn gesprek met Bas Uterwijk. Over hoe hij foto’s maakt van mensen die niet (meer) bestaan.

AI toont de mens achter de kunst. Gesprek met fotograaf-kunstenaar Bas Uterwijk

Toekomst

De snelle ontwikkelingen in acht genomen, en wetende wat er nog zoal in IT-labo’s in de maak is, lijkt een wijdverspreid gebruik van synthetische video onvermijdelijk. Zeker wanneer consumenten en bedrijven een steeds grotere appetijt hebben voor video. Conventionele videoproductie zal hieraan niet tegemoet kunnen komen.

Het vertrouwen van de burger, in pers en sociale media, in de politiek en overheid, is vaak zoek. Het is maar de vraag of dit soort ‘nieuwe predikers’ zullen aanvaard worden.

Het begin van ‘Synthetische polarisatie’?

Wie hou je ter verantwoording? Bij een commerciële boodschap kan dat het achterliggende bedrijf zijn. Bij politieke of activistische videoboodschappen, wordt het vervelend wanneer gevaarlijke of ongepaste berichten de wereld rondgaan, en de brenger niet eens bestaat. Eigenlijk een ‘Synthetische polarisatie’.

Net als bij het gebruik van Artificiële Intelligentie, lijkt het mij noodzakelijk om ethische normen voor synthetische modellen, en andere beelden, te bepalen. Inclusief wanneer en hoe je moet onthullen dat iets in feite niet is wat het lijkt.

Maar regelgeving heeft doorgaans moeite om technologie bij te benen, en dat zal ook nu niet anders zijn.

Steven Dupont

#WhatsNext is een blog over innovatie, kunst en design, gebracht in mensentaal. Op de hoogte blijven? Volg ons op:

En pssst… sharing is caring 🙂

1 reactie