Zien is geloven? Je hebt het gehoord van de persoon zelf? … niets is nog wat het lijkt! Videobeelden worden levensecht nagemaakt, en ook de stem die je hoort kan volledig nep zijn. Je leest hier over Deepfakes en hoe Google de strijd aangaat.

Wat is Deepfake?

Deepfake is een techniek voor het samenstellen van video- (of audio-) manipulatie waarbij via artificiële intelligentie een video gegenereerd wordt die vals is, maar realistisch lijkt.

Bestaande afbeeldingen en video worden gecombineerd en over elkaar gezet met een techniek bekend als generative adversarial network (GAN). Op basis van voldoende beeldmateriaal kan je het hoofd van iemand bovenop andere beelden plaatsen, waarbij dit levensecht lijkt. De benaming “Deepfake” ontstond in 2017.

Eerder schreef ik al over de mogelijkheden en de gevaren van Deepfakes; lees: Ben jij bestand tegen Deepfake?

Gevaar voor de democratie

Met de Amerikaanse presidentsverkiezingen van 2020 in het verschiet is de dreiging van verkiezingsinmenging misschien wel het meest urgent wanneer het gaat om Deepfakes.

We zagen wat er gebeurde met gemanipuleerde beelden van Nancy Pelosi, en meer recentelijk de vervalste video met Bernie Sanders in een, nou… zeg maar “verontrustende” zangpartij.

Als het kiespubliek kan worden overtuigd om valse video’s van presidentskandidaten te geloven en te vertrouwen, dan is de democratie in groot gevaar. In de Verenigde Staten zijn ze zeer begaan over de voortdurende buitenlandse inmenging en makkelijke kwetsbaarheid.

België

In België gebruikte de socialistische partij s.pa (mei 2018) de techniek om een nepvideo van Donald Trump te verspreiden. Daarbij leek het dat de Amerikaanse president het woord richt tot de Belgen om hen te overtuigen uit het klimaatakkoord van Parijs te stappen. Deze actie kreeg wereldwijd heel wat kritiek.

Gelukkig was de video amateuristisch en de kwaliteit niet goed waardoor je door de manipulatie kon heenkijken.

Maar er bestaan video’s waarbij je echt niet meer zeker bent over wat je ziet. Bekijk hier hoe gewezen president Obama het er in een Deepfake video van afbrengt.

Die Deepfakes zijn heus geen ver van ons bed show. Internet maakt de wereld kleiner en nieuws (zeker fake news) reist snel.

Zelfs LinkedIn bleef niet gespaard; toen bleek dat een spionne met een Deepfake-account connectie had gelegd met belangrijke internationale politici.

Lees meer: Over Social Engineering en Deepfake-spionnen op LinkedIn

Google gaat achter Deepfakes aan

Google heeft een gigantische database van Deepfakes vrijgegeven om te helpen bij de bestrijding van…. Deepfakes.

Het bevat 3.000 AI-gegenereerde video’s die zijn gemaakt met behulp van verschillende publiek beschikbare algoritmes.

Het afgelopen jaar zijn generatieve algoritmes zo goed geworden in het synthetiseren van media dat wat ze produceren al snel niet meer te onderscheiden is van de werkelijkheid.

Deepfake database

Deskundigen zijn nu op zoek naar betere manieren om deze zogenaamde Deepfakes op te sporen.

Vorige maand (24 september 2019) bracht Google een open-source database uit met 3.000 originele gemanipuleerde video’s als onderdeel van zijn inspanningen om de ontwikkeling van Deepfake detectietools te versnellen.

Ze werkten samen met 28 acteurs om video’s op te nemen waarin ze met elkaar spreken, gemeenschappelijke uitdrukkingen maken en alledaagse taken uitvoeren. Vervolgens gebruikten ze publiek beschikbare Deepfake-algoritmes om hun gezichten te veranderen.

September 2019 kondigde Facebook aan dat het tegen het einde van het jaar een soortgelijke database zou uitbrengen.

FaceForensics++

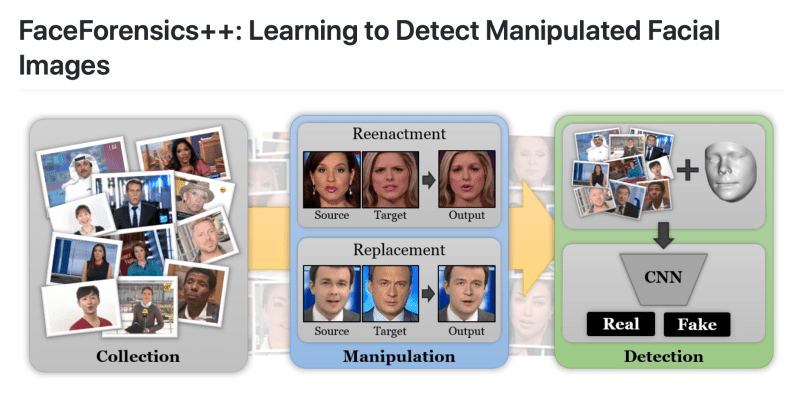

FaceForensics++

In januari heeft een academisch team onder leiding van een onderzoeker van de Technische Universiteit van München er een gecreëerd met de naam FaceForensics++ door op bijna 1.000 gecompileerde YouTube-video’s vier veelgebruikte gezichtsmanipulatiemethoden uit te voeren.

Met elk van deze datasets is het idee hetzelfde: het creëren van een groot scala aan voorbeelden die kunnen helpen bij het trainen en testen van geautomatiseerde detectie-instrumenten.

Kat-en-muisspel

Maar zodra een detectiemethode is ontwikkeld om een fout in een bepaald algoritme te benutten, kan het algoritme eenvoudig worden bijgewerkt om het te corrigeren. Als gevolg daarvan proberen sommige deskundigen nu detectiemethoden te vinden die uitgaan van de perfectie van synthetische beelden.

Anderen stellen dat het terugdringen van Deepfakes niet alleen met technische middelen kan worden bereikt: in plaats daarvan zullen er ook sociale, politieke en juridische oplossingen nodig zijn om de motivatie voor het creëren van deze beelden te veranderen.

Feit is alvast, dat we voortaan niet meer klakkeloos onze eigen ogen en oren mogen geloven.

Lees ook:

- Over Fake News, WhatsApp en echte mensen

- Over Fake News, Sociale Media, Censuur; en een verloren gelopen tepel.

Steven Dupont

#WhatsNext is een Technologie- en Innovatieblog in mensentaal. Op de hoogte blijven? Volg ons op:

3 reacties